- Optimisation des fonctions différentiables sans contrainte.

- Optimisation sous contraintes : Lagrangien, multiplicateurs de Lagrange, optimisation avec contraintes d’égalités, avec contraintes d’inégalités.

- Optimisation des fonctions convexes.

ECUE Optimisation

Code de l'ECUE : SLEAA507

PRESENTATION

L’optimisation de fonctions, généralement de plusieurs variables, est sans conteste celle qui apparait le plus fréquemment dans la modélisation économique (maximiser le bénéfice, la satisfaction des clients, la productivité ou minimiser les coûts, le risque, etc.).

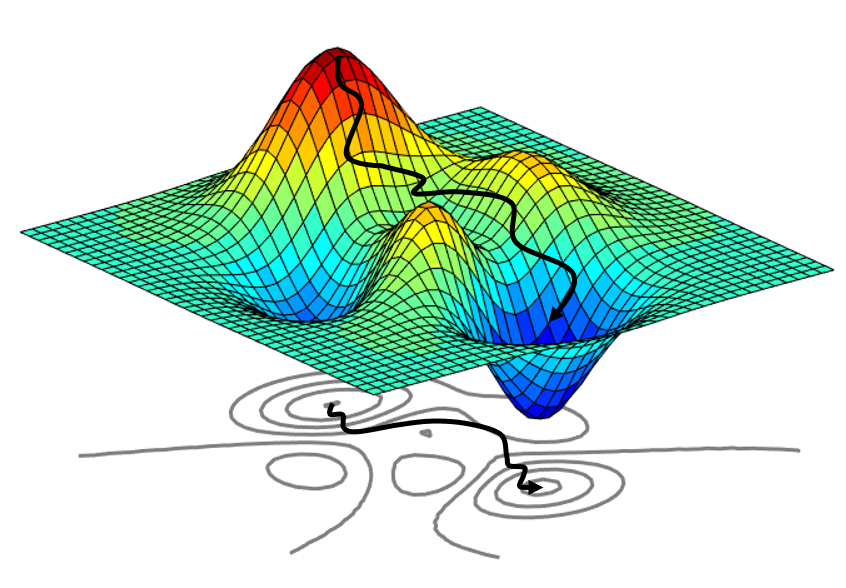

Mathématiquement, l’optimisation se traduit par la recherche des points du domaine en lesquels la fonction étudiée prend une valeur maximale ou minimale. En ces points, la fonction admet un extremum, appelé aussi optimum. On distingue deux grandes classes :

- les extrema locaux, définis dans le voisinage d’un point, pour lesquels sont formulées diverses conditions mathématiques,

- les extrema globaux, valables dans tout le domaine de définition de la fonction, et qui sont souvent les plus utiles dans les applications pratiques.

Nous allons voir que pour avoir des critères simples d’optimisation, il est nécessaire que la fonction à optimiser soit suffisamment régulière, son domaine de définition ait une forme adéquate,et enfin que le cas idèal (obtention d’un optimum global) requière des hypothèses supplémentaires, comme la concavité ou la convexité de la fonction à optimiser.

Responsable(s) du cours

Amina AmassadPrésentiel

- 8h de cours magistral

- 16h de travaux dirigés

PREREQUIS

-

Maîtriser les bases des mathématiques de niveau L1 et L2

OBJECTIFS

- résoudre des problèmes d'optimisation sous contraintes d'égalités en utilisant la méthode des multiplicateurs de Lagrange.

- résoudre des problèmes d'optimisation de fonctions différentiables sans contrainte.

- résoudre des problèmes d'optimisation sous contraintes d’inégalités, les conditions de Kuhn et Tucker.

- résoudre des problèmes d’optimisation de fonctions convexes.

CONTENU

-

Programme détaillé du cours

-

Chapitre 1-I. Préliminaires - Rappels

I-1. Matrice Héssienne

I-2. Matrice Héssienne bordée

I-3. Matrice Jacobienne

I-4. Matrices (semi) définies positives

I-5. Matrices (semi) définies négatives

I-6. Caractérisation d'une matrice carrée symétrique

I-7. Mineurs principaux

I-8. Ensemble convexe

I-9. Ensemble strictement convexe

I-10. Fonctions concaves et fonctions convexes

I-11. Fonctions quasi-concaves et fonctions quasi-convexes

-

Chapitre 1 - II. Génaralités sur l'optimisation

II-1. Définitions(maximum, minimum, optimum local, optimum global,...)

II-2. Conditions nécessaires et suffisantes de l'existence d'un optimum

-

Chapitre 2 - I. Optimisation sans contraintes

I-1. Cas d'une fonction à une seule variable

I-2. Cas d'une fonction de plusieurs variables

-

Chapitre 2- II. Optimisation sous contraintes d'égalités (extrema liés) : le Lagrangien

II.1. Fonctions de deux variables et une contrainte en égalité

II.2. Fonctions de n variables sous contraintes en égalités

-

Chapitre 2 - III. Optimisation sous contraintes d'inégalités : les conditions de Kuhn et Tucker

III.1. Contraintes satur ́ees, contraintes régulières

III. 2. Le théorème de Kuhn et Tucker